Data science & Data Engineering

Kundenmanagement

Erfolgreiches Kundenmanagement ist umfassend und wurde vielfach von Unternehmen aufgrund des damit verbundenen Aufwands vernachlässigt. Kundenzufriedenheit ist jedoch häufig ein elementarer Bestandteil des Unternehmenserfolgs und sollte daher die entsprechende Anerkennung erhalten. Mit den eigenen Kunden effizient, transparent und vertrauensvoll zusammenarbeiten ist dabei essenziell. Data-Science kann dabei Prozesse automatisieren und wesentlich erleichtern ohne dass Kunden ihre Geschäftsgeheimnisse preisgeben müssten. Entgegen den Datenkraken aus dem Web 2.0, bei denen Kunden freiwillig ihre Daten preisgeben sollten, empfiehlt cusy, die Daten für die Data-Science-Auswertung beim Kunden zu belassen und dort auszuwerten. cusy unterstützt Unternehmen dabei, wie Kundendaten aus unterschiedlichsten Quellen konsolidiert und zusammengeführt werden können, Produktarten eines Unternehmens zusammengeführt und das gesammelte Wissen optimal u.a. mit Text Mining- und Sentiment-Analyse ausgewertet werden können.

Prognosen

Doch nicht nur im Kundenmanagement bietet Data-Science fortschrittliche Lösungen, sondern z.B. auch bei der Auftragsprognose: Schwankende Eingänge und heterogenes Lieferverhalten einzelner Lieferanten erschweren die Planbarkeit enorm. Machine-Learning-Modelle können Muster im Lieferantenverhalten erkennen um dann Voraussagen über die zukünftigen Wareneingangsmengen zu treffen. Die besseren Prognosen erlauben nun nicht nur eine bessere Planung von Personal und Lagerflächen sondern auch eine intelligentere Steuerung der Lieferanten, bei der Auslastungsspitzen vorausgeahnt und durch Neuverteilung der Aufträge ausgeglichen werden können.

Logistik

Wenn Zeit Geld ist, dann ist die Reduzierung von Arbeitsaufwänden sehr verlockend. Dabei kann cusy mit Routenoptimierungen unterstützen, sowohl bei der dynamischen Routenoptimierung wie auch bei der Last-Mile-Disposition.

Meldet euch

Ich berate euch gerne und erstelle ein passgenaues Angebot für euer Data-Science-Projekt.

Ich rufe euch auch gerne an!

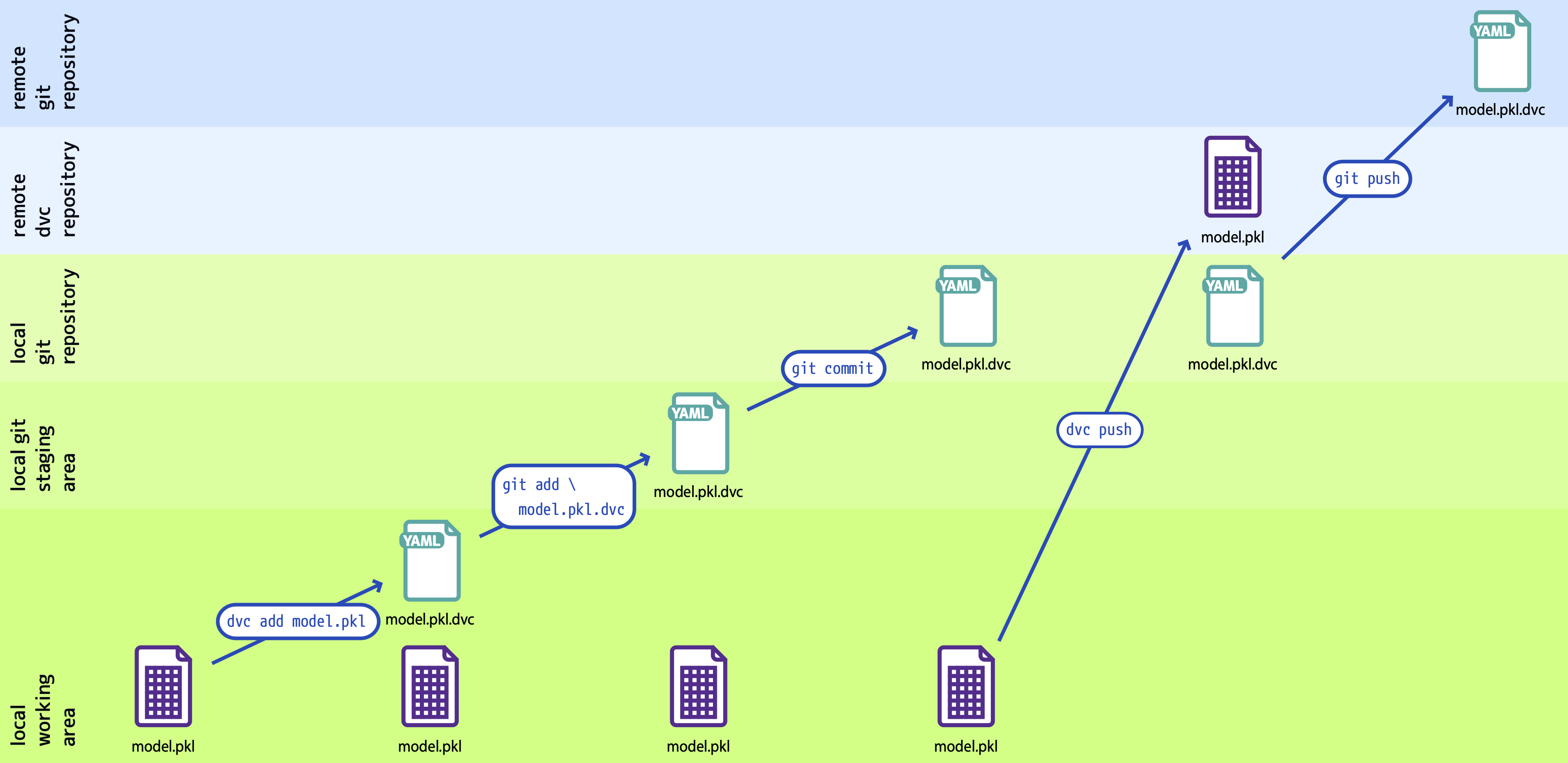

»Versionskontrolle für Machine-Learning-Projekte« in Informatik Aktuell vom 11. August 2020

Cusy schreibt in Informatik Aktuell in loser Reihe Artikel über Data Science Workflows. Als erster Beitrag ist nun Versionskontrolle für Machine-Learning-Projekte am 11. August 2020 erschienen.

In diesem Artikel erfahrt ihr, wie die Modellentwicklung für maschinelles Lernen (ML) systematisch organisiert werden kann. So kann die Leistung eines Modells verbessert werden, wenn ihr die Parameter feiner abgestimmt oder wenn mehr Trainingsdaten verfügbar werden. Um die Verbesserung messen zu können, sollte nachverfolgt werden können, welche Daten für das Training in welcher Modelldefinition und -konfiguration (Parameter etc.) verwendet und welche Modellleistungen damit erzielt wurden. Dabei werden sowohl die Daten wie auch der zugehörige Programmcode in einer Version erfasst werden.

Anhand eines Beispielprojekts führt der Artikel durch die folgenden Phasen:

- Repositories erstellen

- Datenpipelines definieren

- Reproduzieren

- Pipeline visualisieren

- Daten teilen

Unser Fazit ist ,dass mit DVC sprachunabhängig reproduzierbare ML-Pipelines definiert und zusammen mit den zugehörigen Trainingsdaten, Konfigurationen, Leistungsmetriken usw. versioniert gespeichert werden können. Dabei arbeitet DVC mit allen modernen Versionsverwaltungen zusammen und unterstützt viele verschiedene Speicherarten wie S3, Google Cloud, Azure, SSH usw. DVC strukturiert so nicht nur die Datenhaltung, sondern durch einzelne, atomare Phasen der DVC-Pipeline bleiben Änderungen in den Daten auch transparent und nachvollziehbar. Insgesamt erleichtert und effektiviert dies die Arbeit an ML-Projekten erheblich.